Nos usages numériques ne supportent plus l’attente. Entre l’essor de l’Internet des objets, la généralisation de la 5G et l’omniprésence de l’intelligence artificielle, les données doivent être traitées plus vite et plus près des utilisateurs. C’est là qu’intervient le edge computing : une manière de rapprocher la puissance de calcul des capteurs, machines et terminaux afin de gagner en réactivité, en sécurité et en efficacité énergétique. 🚀

Qu’est-ce que le edge computing et pourquoi est-il essentiel aujourd’hui ?

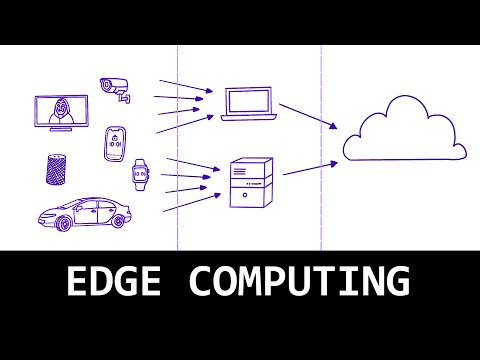

Le edge computing consiste à traiter les données directement à la périphérie du réseau, au plus proche des objets qui les génèrent (capteurs, caméras, smartphones, automates industriels). Plutôt que d’envoyer toutes les informations vers un data center éloigné, elles sont filtrées et analysées localement. Résultat : moins de latence, une bande passante mieux utilisée, et une confidentialité renforcée puisque seules les données essentielles remontent vers le cloud.

Concrètement, une caméra de surveillance peut analyser en temps réel une image et ne transmettre que l’alerte en cas de détection d’intrusion. Une chaîne de production ajuste automatiquement ses paramètres sans attendre le retour d’un serveur central. Dans le jeu en ligne, des micro-serveurs proches des joueurs offrent une expérience plus fluide. 🌐 Ces exemples montrent que le edge n’est pas une alternative au cloud, mais un complément indispensable pour répondre aux usages critiques et instantanés.

Le edge computing, ou informatique en périphérie, est un modèle où le traitement des données se réalise au plus près des dispositifs qui les produisent. Cela permet une plus grande réactivité et une meilleure gestion de la bande passante.

Quels sont les bénéfices concrets pour les entreprises ?

Adopter le edge computing, c’est répondre à des besoins opérationnels immédiats. Les bénéfices apparaissent dès les premiers déploiements et concernent autant la performance que la sécurité ou la durabilité.

⚡ Latence réduite : les décisions se prennent en millisecondes, ce qui est vital pour l’industrie, les véhicules connectés ou la réalité augmentée.

📉 Optimisation des coûts : seuls les événements utiles transitent vers le cloud, évitant l’envoi de flux massifs et coûteux.

🛡️ Résilience : en cas de coupure réseau, les systèmes locaux continuent de fonctionner.

🔐 Confidentialité : le traitement à la source limite l’exposition des données sensibles.

🌱 Impact environnemental : en rapprochant le calcul des objets, on réduit l’empreinte carbone liée aux centres de données centralisés.

| 🧭 Niveau | 📍 Emplacement | ⏱️ Latence | 🧪 Cas d’usage |

|---|---|---|---|

| Cloud | Data centers centralisés | De dizaines à centaines de ms | Stockage, analytique lourde, entraînement IA |

| Fog | Nœuds régionaux ou locaux | Faible à modérée | Agrégation multi-sites, pré-tri de données |

| Edge | Très proche des objets | Millisecondes | Vision, contrôle industriel, AR/VR |

Cette complémentarité explique pourquoi des acteurs comme OVHcloud développent des solutions hybrides où chaque couche trouve sa place, du stockage massif jusqu’à la décision instantanée.

En limitant le transfert de données vers des centres distants, le edge computing contribue à réduire l’empreinte carbone liée au traitement des données, ce qui en fait une solution plus respectueuse de l’environnement.

Edge computing et ses alliés : 5G, IoT et IA

Le edge computing devient réellement puissant lorsqu’il se combine à trois leviers technologiques : la 5G, l’Internet des objets (IoT) et l’intelligence artificielle (IA). Ensemble, ils forment un écosystème capable d’agir en temps réel sur le terrain.

📡 La 5G réduit drastiquement le temps d’accès radio et permet d’isoler des services critiques grâce au network slicing.

🔗 L’IoT multiplie les capteurs qui produisent des données exploitables instantanément.

🧠 L’IA embarquée permet de détecter une anomalie, reconnaître un objet ou optimiser l’énergie directement à la périphérie, sans renvoyer toutes les données brutes.

Un pipeline type illustre bien cette synergie :

- 📡 Capteurs IoT → pré-traitement local (filtrage, chiffrement)

- 🧠 Inférence IA embarquée (vision, maintenance prédictive, NLP)

- 🚀 Action immédiate (arrêt machine, alerte, ajustement automatique)

- ☁️ Remontée sélective vers le cloud (événements, agrégats, historiques)

Pour sécuriser ce tissu numérique, des entreprises spécialisées comme Thales développent des solutions de chiffrement et d’authentification adaptées aux environnements distribués. Cette convergence technologique explique pourquoi le edge n’est plus une expérimentation, mais une architecture adoptée à grande échelle en 2025.

Des cas d’usage réels et retours d’expérience

La valeur du edge computing se mesure surtout sur le terrain. De nombreuses entreprises et collectivités françaises l’expérimentent déjà avec succès, prouvant que cette technologie n’est plus un simple concept.

🏭 Dans l’industrie, Renault utilise des capteurs et des serveurs en périphérie pour anticiper les défaillances dans ses usines, réduisant les arrêts imprévus et améliorant la qualité des pièces.

🚉 La SNCF déploie des solutions de maintenance prédictive dans ses ateliers et sur ses trains, grâce à des modèles IA embarqués capables de détecter en temps réel une anomalie mécanique.

🏥 Dans le secteur de la santé, des hôpitaux français expérimentent le traitement local d’images médicales pour accélérer le diagnostic tout en respectant la confidentialité des données.

🌆 Les villes intelligentes intègrent de plus en plus l’edge pour gérer la circulation ou renforcer la vidéoprotection en filtrant et anonymisant directement les flux vidéo.

🎮 Côté divertissement, des plateformes de jeu en ligne exploitent l’edge pour offrir une latence minimale, essentielle aux expériences immersives.

Domaines où l’edge fait la différence

- 🏭 Industrie 4.0 : contrôle en boucle fermée, robots collaboratifs

- 🏥 Santé connectée : tri local des données sensibles, assistance temps réel

- 🚚 Logistique : traçabilité, capteurs de température, guidage AR

- 🛒 Retail : analyse des flux en magasin, optimisation d’inventaire

- 🎮 Média et jeux : sessions stables, streaming interactif à faible latence

Défis et limites du edge computing

Aussi prometteur soit-il, le edge computing pose plusieurs défis techniques et organisationnels. Déployer des milliers de nœuds distribués exige une infrastructure robuste, des coûts maîtrisés et une sécurité pensée dès la conception. Parmi les principaux obstacles :

💰 Investissements initiaux élevés : matériels spécialisés, serveurs durcis, réseaux 5G privés.

⚙️ Complexité technique : orchestration des conteneurs, supervision multi-sites, mise à jour simultanée des modèles IA.

🛡️ Sécurité renforcée : chaque nœud peut devenir une porte d’entrée s’il n’est pas correctement protégé.

📏 Manque de standards : interopérabilité encore limitée entre fabricants et solutions logicielles.

RGPD, souveraineté et cloud de confiance

Au-delà des aspects techniques, la question de la souveraineté numérique est centrale. Les entreprises européennes doivent s’assurer que les données traitées respectent le RGPD et qu’elles s’appuient sur des infrastructures de confiance. C’est dans ce cadre qu’émergent des initiatives comme Gaia-X, qui vise à bâtir un écosystème cloud et edge européen garantissant la conformité, la transparence et la sécurité des flux de données.

Ces contraintes ne freinent pas l’essor du edge, mais elles obligent les organisations à avancer avec méthode, en évaluant soigneusement la pertinence de chaque cas d’usage avant un déploiement à grande échelle.

Avant de déployer le edge computing dans une entreprise, il est essentiel d’identifier les cas d’usage prioritaires. Cela permettra de cibler les investissements et d’optimiser les bénéfices dès le début du projet.

Comment concevoir et déployer une architecture edge efficace ?

Réussir un projet edge computing ne se limite pas à installer quelques serveurs en périphérie. Il faut une méthodologie structurée pour assurer la fiabilité et la sécurité des déploiements. Trois étapes se révèlent incontournables : identifier les cas d’usage prioritaires, standardiser les briques techniques et orchestrer les opérations à grande échelle.

Les briques techniques qui comptent

- 🧱 Matériel : micro-serveurs durcis, processeurs spécialisés (GPU, TPU), capteurs robustes adaptés à l’industrie.

- 📦 Conteneurs : orchestration légère avec K3s ou MicroK8s pour déployer des applications de manière homogène sur des milliers de sites.

- 🔭 Observabilité : collecte de métriques, logs et supervision des modèles IA pour détecter rapidement les dérives.

- 🔐 Sécurité : chiffrement, authentification forte, segmentation réseau, approche “zero trust”.

- 📡 Réseaux : 5G privée, Wi-Fi 6/7 industriel, commutateurs configurés pour garantir la qualité de service.

Une fois ces briques en place, l’orchestration devient la clé. Déployer des mises à jour de modèles IA, appliquer des correctifs de sécurité ou synchroniser les règles locales doit pouvoir se faire sans interruption de service. C’est souvent ce qui distingue une simple preuve de concept d’un projet réellement industrialisé.

De la preuve de concept à l’échelle

La démarche commence par un POC ciblé sur un site pilote. Si les indicateurs (latence, disponibilité, économie de bande passante) sont concluants, on peut étendre à plusieurs sites via des images système standardisées et une gouvernance claire. Les projets réussis reposent sur des processus reproductibles et une automatisation poussée pour réduire les coûts et éviter les erreurs humaines.

Perspectives et tendances : l’avenir du edge computing

Le edge computing n’en est qu’au début de son expansion. Les prochaines années verront l’arrivée d’usages encore plus ambitieux, où le traitement local deviendra la norme plutôt que l’exception.

🚗 Les véhicules autonomes s’appuieront sur des décisions instantanées prises directement dans les calculateurs embarqués.

🌆 Les villes intelligentes multiplieront les capteurs et algorithmes de vision pour fluidifier les mobilités et renforcer la sécurité.

🤖 L’IA générative embarquée permettra de créer et d’adapter des contenus en temps réel, sans dépendre d’un cloud central.

🌍 Enfin, l’essor de l’edge distribué, combiné à des architectures hybrides, offrira un maillage global où chaque donnée trouvera le lieu de traitement le plus pertinent.

À mesure que ces innovations se déploient, le edge computing deviendra un socle invisible mais indispensable, garantissant une informatique plus réactive, plus sobre et plus proche des besoins humains.

L’évolution vers l’edge distribué promet de créer un réseau global où chaque donnée est traitée au lieu le plus adéquat, offrant une informatique encore plus personnalisée et efficace.

Une révolution discrète mais incontournable

Le edge computing transforme déjà notre rapport au numérique, en rapprochant la puissance de calcul là où les besoins sont les plus pressants. Qu’il s’agisse d’une usine, d’un hôpital, d’une ville ou d’un simple smartphone, cette approche permet de répondre plus vite, de protéger mieux et de consommer moins.

À l’heure où chaque milliseconde compte, le edge s’impose comme un allié du cloud, et non comme son rival. C’est cette complémentarité qui dessine une informatique plus agile, plus respectueuse des données et plus durable. Une révolution qui s’installe en douceur, mais dont l’impact sera majeur pour les entreprises et pour la société tout entière. 🌍